スマートフォンで撮影された将棋局面をAIが認識

スマートフォンで撮影された将棋局面をAIが認識

国立大学法人東京農工大学大学院工学府(中川研究室)の博士前期課程2年佐藤旭と博士前期課程1年森住啓は、将棋盤面と持ち駒をスマートフォンで撮影してWebサーバに送信すると、AI(人工知能)が即座に認識して局面データとして変換するWebアプリを開発し、公開しました。盤上の認識には、深層ニューラルネットワークを利用し、認識精度は99%以上を達成しました。これは、日本でも世界でも初めてのサービスです。9月に開催されるニコニコ技術タグ有志開催NT名古屋2019と、10月に開催される電子情報通信学会 パターン認識・メディア理解研究会にて発表を行う予定です。

ニコニコ技術タグ有志開催NT名古屋2019 2019年9月23日(月)

電子情報通信学会 パターン認識・メディア理解研究会 2019年10月18日(金)

方式

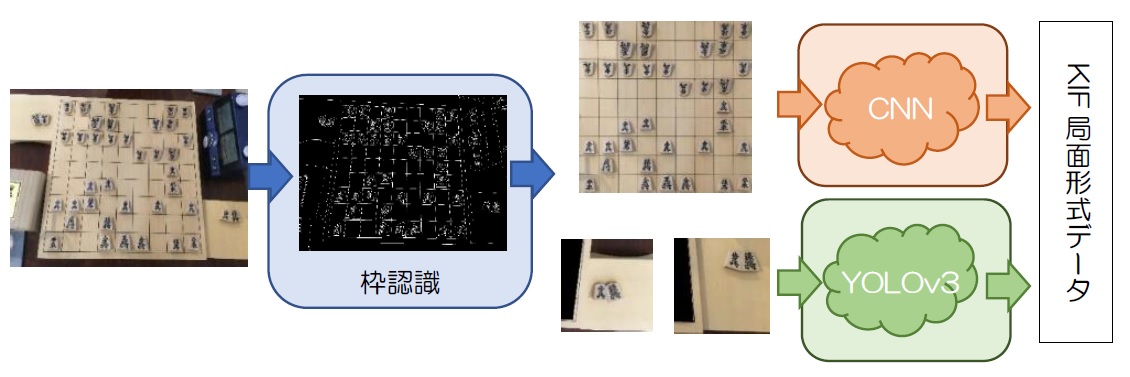

将棋盤の画像認識は、図1のように、「将棋盤の枠を認識する」、「将棋盤に乗っている駒を認識する」、「将棋盤に乗っていない持ち駒を認識する」の3フェーズに分かれています。

将棋盤の枠を認識するために、Line Segment Detector(LSD: 線分検出器)を用いて画像内の直線を検出し、パターンの一致度から将棋盤の枠の検出を行います。計算量を減らし高速に検出するために、輪郭検出による将棋盤の枠1つ1つの四角形の抽出を行い、数パターンの候補から選ぶシステムとしました。将棋盤上の駒認識を行うために、将棋盤枠内の画像を9×9に分割し、一つ一つをConvolutional Neural Network (CNN: 畳込みニューラルネットワーク)で認識します。持ち駒の認識を行うためには、将棋盤の右下、左上部分の画像を取得し、物体認識手法であるYOLOv3(You Only Look Once)を用いて認識します。どちらも置き方により斜めになる可能性がありますが、学習用データベースの拡張により対応しました。

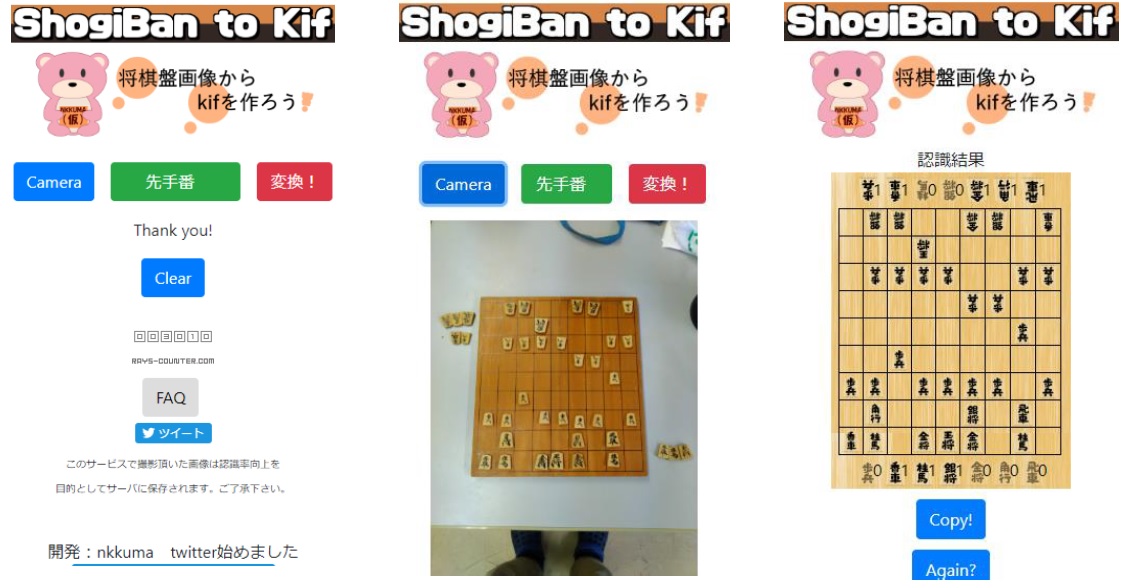

認識した結果は最終的にKIF局面形式(別名:BOD形式)に変換します。ユーザ側にはその形式をもとに認識した結果をGUIで表示します。

盤上・持ち駒の認識用モデルの学習に用いたデータベースは、農工大将棋部の駒・盤や自分が所有しているもの、インターネットで公開されている画像などから収集して作成しました。一文字駒や二文字駒、裏が赤い駒や黒い駒、特殊なフォントなど、さまざまな種類の駒を含むようにしました。ユーザの撮影環境が一定ではないので、明暗を変えた画像や大きさを変えた画像も用いました。また、将棋の駒の文字だけのデータも元画像から手動で作成し、CNNやYOLOv3のモデルが文字に注目するようにしました。

実際に将棋カフェなどで撮影した、モデルの学習に用いていないテストデータの結果では、枠認識については91%、盤上の認識については99.78%、持ち駒の認識については適合率が73.4%、再現率が97.9%の認識率となりました。枠認識がうまくいかないときは、撮影者がすぐに気づくように表示を行い、再撮影して送信してもらえるようになっています。

今後の展開

将棋盤の画像認識によって局面をデータ化するツールは、自分の対局を振り返り棋力を向上させる強力なツールとなります。また、スーパーコンピュータでも全局面を探索できないといわれる将棋の局面データをいくつも蓄積することで、将棋のさらなる解析に用いることができます。

今回、期待していたより枠の認識率が低かったのは、斜めに撮影された画像や、ぶれた画像が含まれていた影響が考えられます。これらについては今後改善の余地があります。しかし、うまく認識できなかった場合はユーザに再撮影を依頼するシステムとなっているため、大きな問題にはなりません。それ以上に、ほとんどの場合で一枚撮影するだけで局面データ化することができるのは意義があります。ほかのアプリにも連携しているため、認識率だけでなくツールとしての利用価値もさらに発展をさせていきたいと考えています。

◆研究に関する問い合わせ◆

東京農工大学大学院工学研究院

先端情報科学部門 教授

中川 正樹(なかがわ まさき)

TEL/FAX:042-388-7144

メール:nakagawa(ここに@を入れてください)cc.tuat.ac.jp

関連リンク(別ウィンドウで開きます)

- 東京農工大学 中川正樹教授 研究者プロフィール

- 東京農工大学 中川正樹教授 研究室ウェブサイト

- 中川正樹教授が所属する 東京農工大学工学部知能情報システム工学科

- 公開されているWEBアプリ「ShogiBan to Kif」